Pernah nggak sih kamu scroll TikTok atau YouTube dan merasa kayak lagi berada di dunia yang isinya cuma orang-orang yang setuju sama kamu? Nah, itu bukan kebetulan. Itu adalah hasil kerja sistem rekomendasi—alias algoritma yang ngatur apa yang kamu lihat di platform digital.

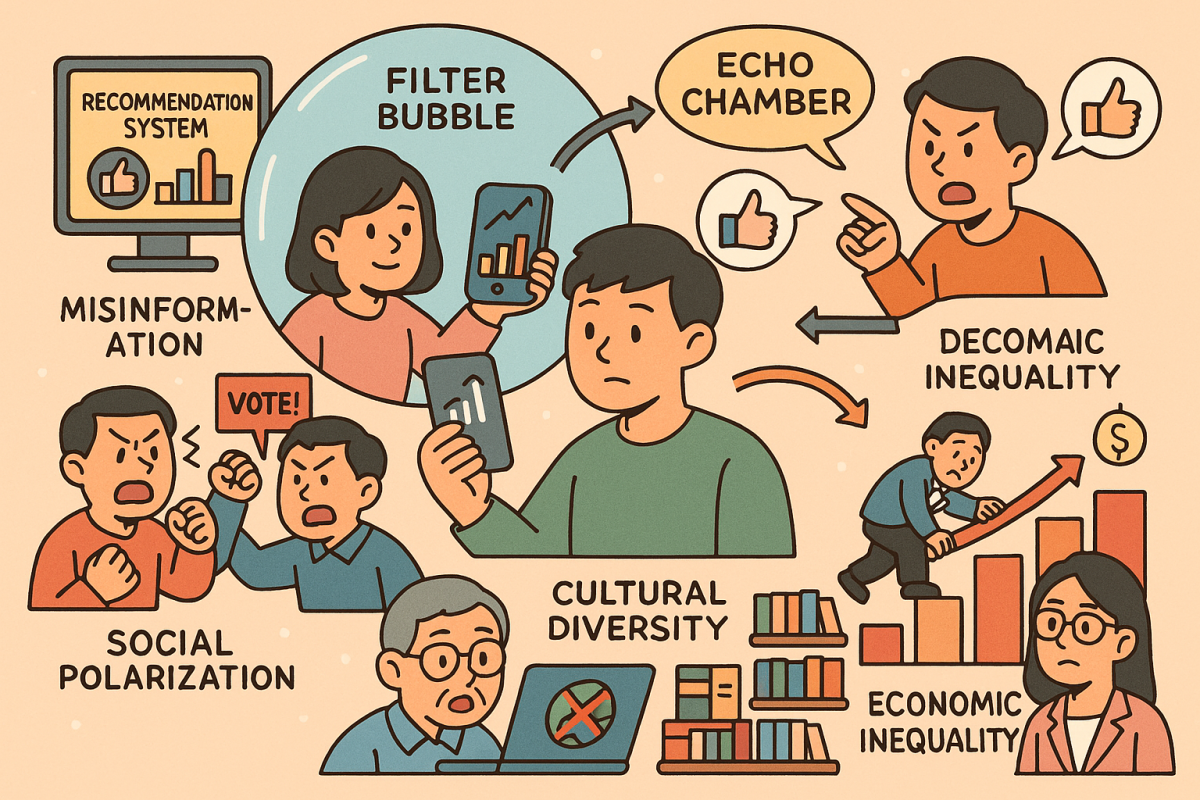

Salah satu kekhawatiran besar terkait algoritma rekomendasi adalah potensi mereka dalam memupuk filter bubble dan echo chamber, yang dapat membatasi individu terhadap informasi yang beragam sehingga meningkatkan polarisasi politik dan sosial (Kawahata, 2024). Desain algoritma rekomendasi cenderung memprioritaskan konten yang mirip dengan apa yang telah disukai oleh pengguna lain sehingga mendorong lingkungan di mana pengguna lebih banyak terpapar informasi yang mengkonfirmasi keyakinan mereka sebelumnya. Kurangnya paparan terhadap perspektif yang beragam dapat memperkuat bias dan berpotensi mengarah pada pandangan ekstrimis (Bojić, et al. 2021).

Namun, penelitian juga menunjukkan bahwa dampak sistem rekomendasi terhadap polarisasi politik mungkin lebih kompleks daripada yang diperkirakan. Beberapa studi menunjukkan bahwa preferensi dan pilihan pengguna memiliki peran signifikan dalam membentuk pola konsumsi informasi mereka (Pavlak, 2025). Kemauan pengguna untuk secara aktif mencari pandangan yang beragam, bisa memberikan pengaruh yang lebih kuat dibandingkan dengan sistem rekomendasi itu sendiri (Liu, et al., 2025). Selain itu, penelitian tersebut juga menunjukkan bahwa efek jangka pendek dari algoritma rekomendasi terhadap sikap politik pengguna mungkin tidak sebesar yang diperkirakan sebelumnya. Meski demikian, konsekuensi jangka panjang dari sistem rekomendasi terhadap pembentukan dan penguatan opini sosial masih perlu diteliti lebih lanjut.

Sistem rekomendasi juga berkontribusi dalam memfasilitasi penyebaran misinformasi dan disinformasi (hoaks) secara daring (Jayakumar, 2024). Algoritma-algoritma ini dapat secara tidak sengaja mempromosikan konten yang sensasional atau emosional, termasuk informasi-informasi yang keliru atau menyesatkan (eSafetyCommissioner, 2022). Dengan membatasi perspektif yang beragam, sistem rekomendasi dapat membuat pengguna lebih rentan untuk menerima informasi yang keliru sebagai kebenaran (Fernandez & Bellogin, 2020).

Selain itu, ketergantungan terhadap sistem rekomendasi untuk mengonsumsi konten, seperti musik, film, dan sastra, telah menimbulkan kekhawatiran terhadap keberagaman budaya (Moradi, et al. 2025). Masalah utama dalam konteks ini adalah bias popularitas, di mana sistem rekomendasi cenderung merekomendasikan produk atau konten populer karena jumlah data interaksi pengguna yang lebih besar. Bias ini dapat menyebabkan representasi yang berlebihan dari budaya yang lebih dominan, sementara meminggirkan kelompok marjinal dan ekspresi budaya mereka. Amplifikasi algoritmik dari konten mainstream dapat menyebabkan homogenisasi budaya, membatasi keragaman budaya, dan berpotensi menghambat penemuan produk budaya dari kelompok minoritas atau niche (Zhou et al., 2010).

Pengaruh sistem rekomendasi juga berpotensi memperburuk ketimpangan ekonomi yang ada (Yohe, 2023). Cara sistem rekomendasi dalam memengaruhi kompetisi pasar juga dapat memiliki konsekuensi ekonomi. Algoritma yang sangat mendukung barang-barang populer dapat membuat pendatang baru kesulitan untuk mendapatkan visibilitas, sehingga mengurangi inovasi (Calvano, et al. 2023). Oleh karena itu, pertimbangan yang cermat tentang keadilan dan kesetaraan dalam desain sistem rekomendasi sangat penting untuk mencegah penguatan ketimpangan ekonomi dan mendorong pasar digital yang lebih inklusif dan kompetitif.

Mengingat peran sentral mereka dalam memediasi informasi, sistem rekomendasi memiliki pengaruh signifikan terhadap proses demokrasi dan kohesi sosial. Di era ini, algoritma telah bertindak sebagai penjaga gerbang untuk menentukan konten mana yang menjadi sorotan dan suara mana yang didengar. Kecenderungan beberapa sistem rekomendasi untuk menciptakan filter bubble dan echo chamber, seperti yang telah dibahas sebelumnya, dapat membatasi paparan warga terhadap berbagai perspektif, yang berpotensi menghambat diskursus politik dan semakin mendorong polarisasi sosial.

Referensi:

- Fernandez, M., & Bellogín, A. (2020). Recommender systems and misinformation: the problem or the solution?.

- Moradi, A., Neophytou, N., Carichon, F., & Farnadi, G. (2025, April). Embedding Cultural Diversity in Prototype-based Recommender Systems. In European Conference on Information Retrieval (pp. 17-31). Cham: Springer Nature Switzerland.

- Zhou, T., Kuscsik, Z., Liu, J. G., Medo, M., Wakeling, J. R., & Zhang, Y. C. (2010). Solving the apparent diversity-accuracy dilemma of recommender systems. Proceedings of the National Academy of Sciences, 107(10), 4511-4515.

- Yohe, K. A. (2023). Towards Global, Socio-Economic, and Culturally Aware Recommender Systems. arXiv preprint arXiv:2312.05805.

- Li, L. (2017). Economics of Recommender Systems in Online Marketplaces (Doctoral dissertation).

- Calvano et al. (2023). AI-powered recommendations enhance users’ experience but lessen competition

Disclaimer: Sebagian konten dalam tulisan ini dikembangkan dengan bantuan teknologi kecerdasan buatan (AI). Ide utama dan draf awal tulisan merupakan kontribusi orisinal penulis. AI digunakan sebagai alat bantu untuk mempercepat penulisan (OpenAI ChatGPT), mencari dan mengumpulkan literatur yang relevan (DeepSearch, Google Gemini), serta menciptakan ilustrasi di awal (ChatGPT). Penulis tetap melakukan kurasi dan pengeditan naskah, serta pengecekan terhadap literatur untuk memastikan akurasi dan relevansinya. Penggunaan AI tidak menggantikan tanggung jawab intelektual penulis, melainkan berfungsi sebagai mitra kreatif dalam pengembangan materi.